我这个人,干啥都喜欢先自己上手试试,这回研究“谷歌人体项目”也不例外。最初根本不是冲着什么医学教育去的,我是想搞个AR应用。

去年下半年,我接了个活,给一个职校的生物课设计一套互动模型。客户要求不高,就是能把心肝脾肺肾弄成3D的,学生戴上眼镜能转着看。我想着这不就是小菜一碟吗?

我立马翻箱倒柜找资料,在网上扒拉了一堆免费模型。结果?不是精度太差,就是贴图粗糙得像十年前的页游。随便放大一点,器官边缘全是锯齿,根本没法用在教学上。客户一看就直摇头,说这玩意儿还不如看书上的图清晰。

模型不达标,那我肯定得找更专业的资源。我咬着牙决定花钱买套高精度数据。我当时就琢磨,既然是教育应用,那肯定得是能经得起推敲的。在各种学术论坛和专业建模社区里摸爬滚打了好几天,终于被我挖出了“Visible Human Project”这个老底子。再往后一追,自然就牵扯出了像谷歌、微软这种大厂利用这些原始数据做二次开发的事情。

砸钱找源头:我怎么找到了谷歌人体数据?

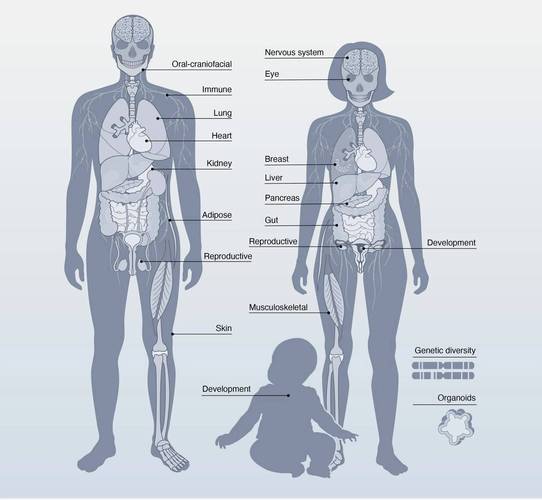

我当时的想法很直接:大公司出的东西,肯定错不了。我开始疯狂地搜索谷歌在“人体可视化”上到底扔了多少资源。他们做的不是那种市面上流行的娱乐App,而是面向专业医疗和教育机构的。我翻阅了好多年前的技术报告,追踪了几个关键的研究人员的动态。我发现,谷歌是把这些超高精度数据,结合AI和渲染技术,搞成了一套教育用的系统。虽然他们不直接卖模型,但是他们提供的平台和工具,简直就是给教育界开了一条高速公路。

我深入钻研了他们那个三维重建的逻辑。以前的模型,你要么看得到骨骼,要么看得到血管,想要同时看清楚,就得自己手动分层剥离。谷歌这套牛在哪儿?它实现了实时切片和病理模拟。你想看心脏瓣膜在跳动中是什么状态,它就能给你模拟出来,而且精度高得吓人。这些数据,都是从真实的超高精度断层扫描中提炼出来的,比普通建模师做出来的“艺术品”强太多了。

我总结了一下这套东西对医学教育的冲击,真是颠覆性的。

- 它解决了传统解剖学“尸源”不足的大问题。学生不用挤在解剖室里闻福尔马林,直接在屏幕上就能“动手”。

- 它提供了无限次的错误尝试机会。操作失误?点一下重置,再来一次,书本上可做不到。

- 它降低了理解复杂三维结构体的门槛。以前只能靠想象,现在直接能转、能切、能放大,甚至还能看清微小的神经纤维走向。

虽然我那点小小的AR项目没能直接用上谷歌的商业数据(太贵了,也拿不到授权),但是我学习了他们的底层逻辑和数据处理方式。我回去把我买的那堆半成品模型重新处理了一遍,用学到的分层渲染技术进行了优化,效果立马提升了好几个档次。客户虽然没看出来我背后下了多大的功夫,但是验收的时候乐开了花。

这回实践下来,我真的感受到了顶尖技术对基础教育的推动力。谷歌人体项目现在怎么样了?它没有像一些火爆一时的消费级产品那样天天上头条,但它已经悄悄地成为了医学教育界基础设施的一部分,稳稳当当,持续输送着高质量的数字“尸体”。我记录下这段经历,就是想告诉大家,很多时候,改变我们生活的东西,都是在背后默默发力的,我们只是需要找到门道,挖出这些宝藏。